16G内存运行本地代码大模型实测:DeepSeek Coder V2 Lite安装指南

很多朋友问:16G内存的电脑能不能跑本地代码大模型?经过实测,答案是完全可以!本文分享我的完整配置经验。

硬件配置实测

测试机型:2020款Intel i7 + 16G内存 Windows笔记本,同时后台开着Chrome 20个标签、微信、IDEA,约占7G内存。

剩余约9G内存运行模型完全OK,加载后剩余内存约500MB,没有发生交换内存,CPU/GPU占用率70%左右。

模型选择建议

推荐两款模型:

避坑提示:16G内存千万别碰Q8_0版本(16GB),会爆内存!

IDE工具对比

主流三种方案实测:

| 方案 | 工具 | 优点 | 缺点 |

| A | Ollama + Continue | 免费、断网可用、隐私安全 | 配置稍麻烦 |

| B | Cursor | 集成Claude 3.5、开箱即用 | 收费20刀/月 |

| C | ChatGPT官方插件 | 官方原生 | 经常抽风、有上下文限制 |

极客首选方案A:免费+隐私+可自定义模型配置。

Ollama + Continue 安装步骤

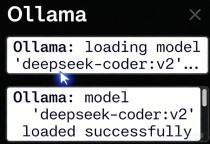

- 下载Ollama:访问ollama.com,一键安装

- 拉取模型:终端输入

ollama run deepseek-coder-v2 - VS Code安装Continue插件

- 配置config.json,provider改成ollama

- 按Ctrl+L唤起对话框开始写代码

代码能力对比

实测写样板代码和算法题,DeepSeek完胜且免费;复杂业务逻辑和系统架构仍是GPT-4o更强,但DeepSeek可以作为绝佳的"副驾驶"。

最优解:用DeepSeek处理80%的重复coding工作,用GPT-4o做最终Code Review。本地运行不仅省钱,代码还不用上传第三方平台!

The End

发布于:2026-03-09,除非注明,否则均为原创文章,转载请注明出处。